Investigadores japoneses han desarrollado una tecnología capaz de reconocer los números (del 0 al 9) con un 90% de exactitud usando ondas cerebrales o electroencefalogramas (EEG) mientras los sujetos pronuncian esos números.

La tecnología también ha realizado el reconocimiento de hasta 18 tipos de monosílabos (japoneses) a partir de las señales EEG. En este caso con un 61% de precisión, lo que permitirá una máquina de escribir activada por EEG en el futuro, según los investigadores.

Los resultados de esta investigación serán presentados en agosto próximo en el marco de Interspeech 2017, que se desarrollará en Estocolmo, informa la Toyohashi University of Technology en un comunicado.

En general, los seres humanos somos capaces de entender una frase si captamos al menos el 80 por ciento de sus sílabas. El logro tecnológico es el resultado de un cambio en la estrategia respecto al método convencional con el que se intentaba desarrollar esta comunicación entre cerebro y máquina.

Potentes algoritmos

En anteriores intentos, la decodificación del habla a partir de señales EEG ha tenido dificultades notables a la hora de recoger suficientes datos como para permitir el uso fiable de algoritmos potentes basados en el aprendizaje automático.

Los investigadores japoneses, sin embargo, han desarrollado una estrategia distinta que permite alcanzar un alto rendimiento con un pequeño conjunto de datos para entrenamiento del sistema.

La nueva estrategia se basa en el reconocimiento holístico de patrones utilizando la teoría de categorías, que introduce un espacio dual y un espacio tensorial e incluye el álgebra exterior, utilizada en matemáticas para calcular volúmenes y superficies.

La teoría de categorías es un estudio matemático que axiomatiza de forma abstracta diversas estructuras matemáticas como una sola, mediante el uso de objetos y morfismos. Al mismo tiempo trata de mostrar una nueva forma de ver las matemáticas sin incluir las nociones de elementos, pertenencia, entre otras.

La ventaja de la estrategia japonesa es que con más de un dato, como la voz, las ondas cerebrales, la duración del pensamiento o la duración de la pronunciación, la máquina puede utilizar algoritmos para interpretar información basada en un método llamado "aprendizaje profundo", a través del cual la máquina logra aprender, corregirse y perfeccionarse con el tiempo.

La tecnología también ha realizado el reconocimiento de hasta 18 tipos de monosílabos (japoneses) a partir de las señales EEG. En este caso con un 61% de precisión, lo que permitirá una máquina de escribir activada por EEG en el futuro, según los investigadores.

Los resultados de esta investigación serán presentados en agosto próximo en el marco de Interspeech 2017, que se desarrollará en Estocolmo, informa la Toyohashi University of Technology en un comunicado.

En general, los seres humanos somos capaces de entender una frase si captamos al menos el 80 por ciento de sus sílabas. El logro tecnológico es el resultado de un cambio en la estrategia respecto al método convencional con el que se intentaba desarrollar esta comunicación entre cerebro y máquina.

Potentes algoritmos

En anteriores intentos, la decodificación del habla a partir de señales EEG ha tenido dificultades notables a la hora de recoger suficientes datos como para permitir el uso fiable de algoritmos potentes basados en el aprendizaje automático.

Los investigadores japoneses, sin embargo, han desarrollado una estrategia distinta que permite alcanzar un alto rendimiento con un pequeño conjunto de datos para entrenamiento del sistema.

La nueva estrategia se basa en el reconocimiento holístico de patrones utilizando la teoría de categorías, que introduce un espacio dual y un espacio tensorial e incluye el álgebra exterior, utilizada en matemáticas para calcular volúmenes y superficies.

La teoría de categorías es un estudio matemático que axiomatiza de forma abstracta diversas estructuras matemáticas como una sola, mediante el uso de objetos y morfismos. Al mismo tiempo trata de mostrar una nueva forma de ver las matemáticas sin incluir las nociones de elementos, pertenencia, entre otras.

La ventaja de la estrategia japonesa es que con más de un dato, como la voz, las ondas cerebrales, la duración del pensamiento o la duración de la pronunciación, la máquina puede utilizar algoritmos para interpretar información basada en un método llamado "aprendizaje profundo", a través del cual la máquina logra aprender, corregirse y perfeccionarse con el tiempo.

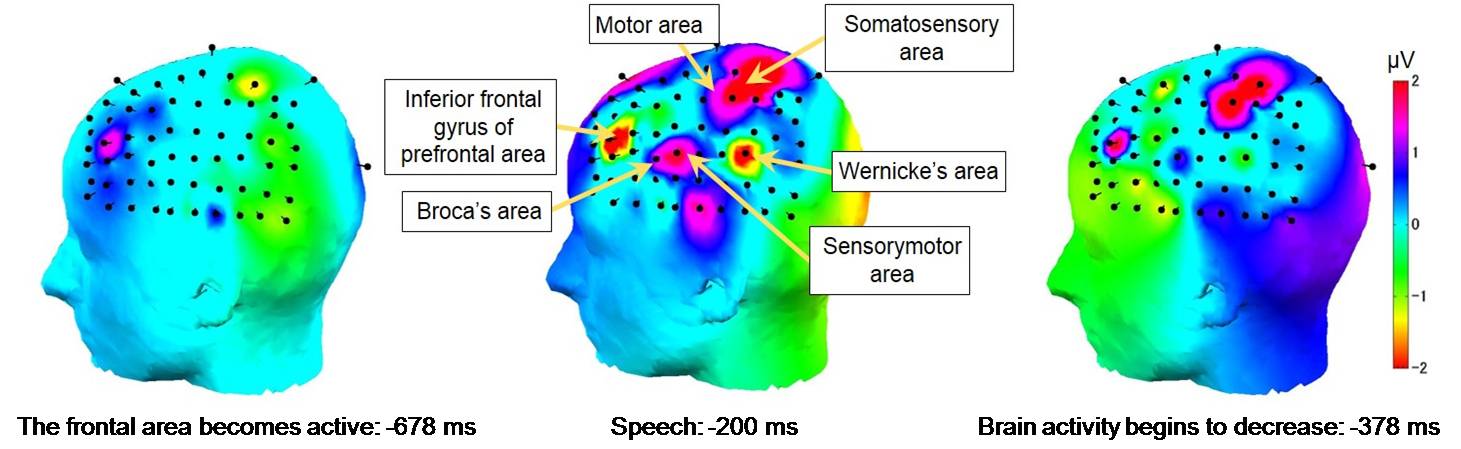

Cambios en la actividad cerebral (promedio de 10 sílabas para 8 sujetos). Crédito: Universidad Tecnológica de Toyohashi

Interfaz computacional cerebral

Según ha explicado el profesor Tsuneo Nitta, investigador principal del estudio, “el próximo paso será desarrollar una interfaz computacional cerebral, que reconozca los enunciados sin voz”.

Esta tecnología podría permitir que las personas con discapacidades, que han perdido la habilidad de comunicarse verbalmente, la recuperen de nuevo al menos en lo esencial.

Se espera asimismo que la tecnología proporcione a una persona sana una interfaz sin las limitaciones de los sistemas actuales, como teclados, pantallas táctiles y ratones, y sin necesidad de los sistemas de reconocimiento acústico del habla.

Una de las aplicaciones de esta nueva tecnología podría materializarse en cinco años: un dispositivo que pueda ser usado con menos electrodos. Este dispositivo, conectado a un teléfono inteligente, permitiría incluso su control mediante los pensamientos del usuario, según los investigadores.

Según ha explicado el profesor Tsuneo Nitta, investigador principal del estudio, “el próximo paso será desarrollar una interfaz computacional cerebral, que reconozca los enunciados sin voz”.

Esta tecnología podría permitir que las personas con discapacidades, que han perdido la habilidad de comunicarse verbalmente, la recuperen de nuevo al menos en lo esencial.

Se espera asimismo que la tecnología proporcione a una persona sana una interfaz sin las limitaciones de los sistemas actuales, como teclados, pantallas táctiles y ratones, y sin necesidad de los sistemas de reconocimiento acústico del habla.

Una de las aplicaciones de esta nueva tecnología podría materializarse en cinco años: un dispositivo que pueda ser usado con menos electrodos. Este dispositivo, conectado a un teléfono inteligente, permitiría incluso su control mediante los pensamientos del usuario, según los investigadores.

Tendencias Científicas

Tendencias Científicas

La Inteligencia Artificial puede ver a través del espejo

La Inteligencia Artificial puede ver a través del espejo CIENCIA ON LINE

CIENCIA ON LINE