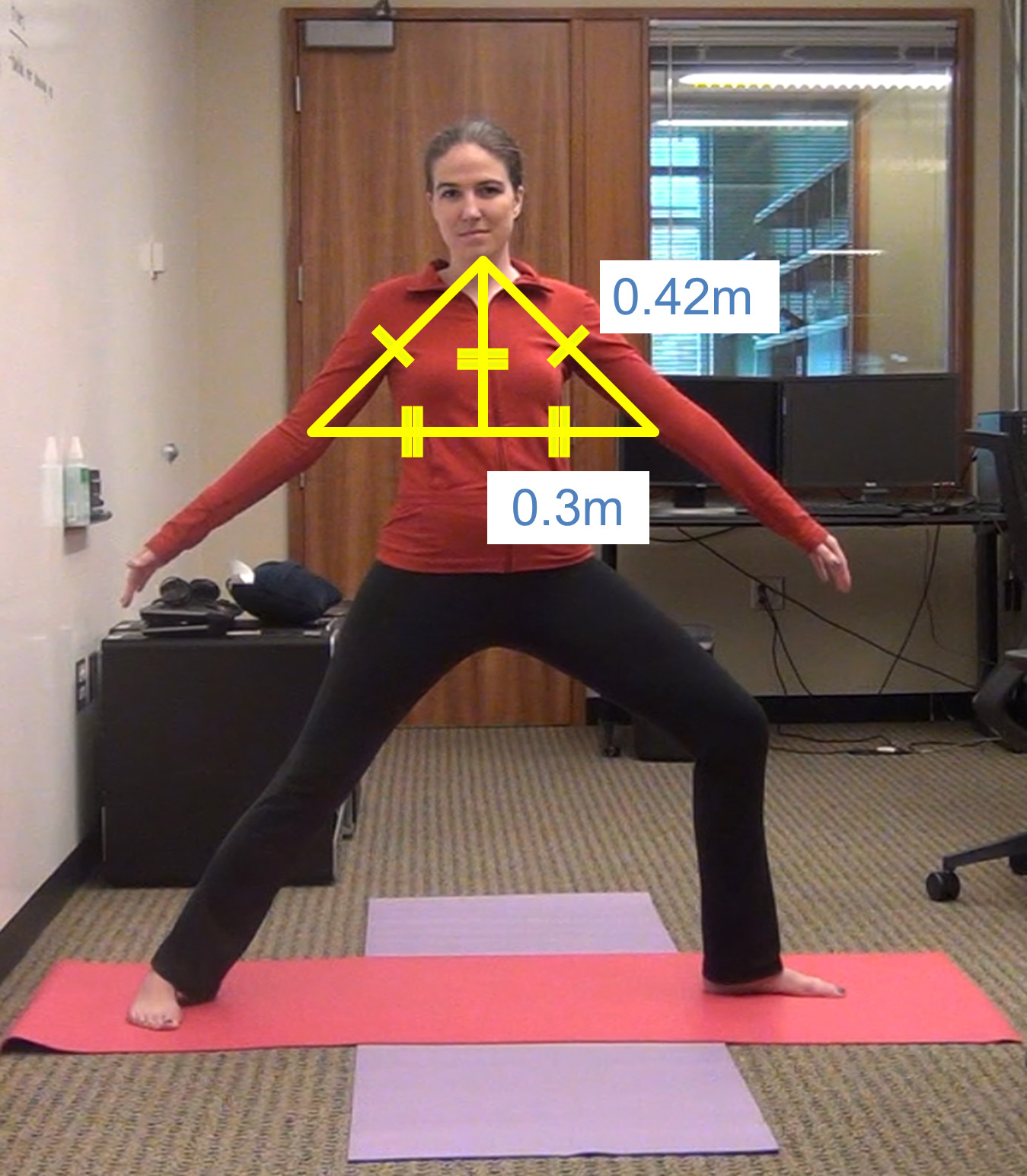

La investigadora Kyle Rector, adoptando una postura de yoga incorrecta, que es analizada por el programa. Imagen: Kyle Rector. Fuente: Universidad de Washington.

En una típica clase de yoga, los estudiantes ven a un instructor para aprender a mantener una postura correcta. Pero para las personas que son ciegas o no puede ver bien, puede ser frustrante participar en este tipo de ejercicios .

Ahora, un equipo de científicos informáticos de la Universidad de Washington (Seattle, EE.UU.) ha creado un programa de software que vigila los movimientos del usuario y proporciona información hablada sobre lo que se ha de cambiar para completar correctamente una postura de yoga.

El programa, llamado Yoga sin ojos, utiliza el software de Microsoft Kinect para rastrear los movimientos del cuerpo y ofrecer información auditiva en tiempo real sobre seis posturas de yoga, incluyendo las del guerrero.

La alumna de doctorado Kyle Rector, coordinadora del proyecto, escribió un código de programación que instruye a Kinect para captar los ángulos del cuerpo de un usuario, y a continuación da información verbal para recolocar los brazos, las piernas, el cuello o la espalda y completar la pose. Por ejemplo, el programa podría decir: "Gire sus hombros a la izquierda ", o "inclínese lateralmente hacia la izquierda."

El resultado es un exergame (ejerjuego, un videojuego utilizado para el ejercicio) que permite a las personas ciegas interactuar verbalmente con un instructor de yoga simulado.

Cada una de las seis posturas tiene cerca de 30 diferentes comandos de mejora basados en una docena de reglas que se consideran esenciales para cada posición de yoga. Rector trabajó con varios instructores de yoga para reunir los criterios que permiten alcanzar la colocación correcta en cada postura.

Kinect primero comprueba el tronco de una persona y sugiere algún cambio, luego va hacia la cabeza y el cuello, y, finalmente, a los brazos y las piernas. También da una respuesta positiva cuando la persona tiene la postura correcta.

Ahora, un equipo de científicos informáticos de la Universidad de Washington (Seattle, EE.UU.) ha creado un programa de software que vigila los movimientos del usuario y proporciona información hablada sobre lo que se ha de cambiar para completar correctamente una postura de yoga.

El programa, llamado Yoga sin ojos, utiliza el software de Microsoft Kinect para rastrear los movimientos del cuerpo y ofrecer información auditiva en tiempo real sobre seis posturas de yoga, incluyendo las del guerrero.

La alumna de doctorado Kyle Rector, coordinadora del proyecto, escribió un código de programación que instruye a Kinect para captar los ángulos del cuerpo de un usuario, y a continuación da información verbal para recolocar los brazos, las piernas, el cuello o la espalda y completar la pose. Por ejemplo, el programa podría decir: "Gire sus hombros a la izquierda ", o "inclínese lateralmente hacia la izquierda."

El resultado es un exergame (ejerjuego, un videojuego utilizado para el ejercicio) que permite a las personas ciegas interactuar verbalmente con un instructor de yoga simulado.

Cada una de las seis posturas tiene cerca de 30 diferentes comandos de mejora basados en una docena de reglas que se consideran esenciales para cada posición de yoga. Rector trabajó con varios instructores de yoga para reunir los criterios que permiten alcanzar la colocación correcta en cada postura.

Kinect primero comprueba el tronco de una persona y sugiere algún cambio, luego va hacia la cabeza y el cuello, y, finalmente, a los brazos y las piernas. También da una respuesta positiva cuando la persona tiene la postura correcta.

Errores

Rector practicó un montón de yoga mientras desarrollaba esta tecnología. Ella misma cometió errores deliberados para comprender mejor cómo corregirlos. "Lo he probado completamente conmigo misma, así que me siento cómodo teniendo a alguien que lo pruebe", señala en la nota de prensa de la universidad.

La investigadora trabajó con 16 personas ciegas y con baja visión de la zona del estado de Washington para poner a prueba el programa y obtener ideas. Varios de los participantes nunca habían hecho yoga antes, mientras que otros lo habían intentado un par de veces o recibían clases de yoga con regularidad. Trece de las 16 personas dijeron que recomendarían el programa y casi todo el mundo lo usaría de nuevo.

La tecnología utiliza geometría simple y la ley de los cosenos para calcular los ángulos creados en el yoga. Por ejemplo, en algunas posturas una pierna doblada debe estar en un ángulo de 90 grados, mientras que el brazo extendido debe formar un ángulo de 160 grados.

Rector optó por utilizar el software de Kinect porque es de código abierto y de fácil acceso en el mercado, pero dijo que tiene algunas limitaciones en el nivel de detalle con el que se detecta el movimiento .

El equipo de científicos piensa hacer que esta tecnología esté disponible online para que los usuarios puedan descargar el programa, conecten su Kinect y empiecen a hacer yoga. El equipo también está llevando a cabo otros proyectos que ayudan con el ejercicio físico.

Rector practicó un montón de yoga mientras desarrollaba esta tecnología. Ella misma cometió errores deliberados para comprender mejor cómo corregirlos. "Lo he probado completamente conmigo misma, así que me siento cómodo teniendo a alguien que lo pruebe", señala en la nota de prensa de la universidad.

La investigadora trabajó con 16 personas ciegas y con baja visión de la zona del estado de Washington para poner a prueba el programa y obtener ideas. Varios de los participantes nunca habían hecho yoga antes, mientras que otros lo habían intentado un par de veces o recibían clases de yoga con regularidad. Trece de las 16 personas dijeron que recomendarían el programa y casi todo el mundo lo usaría de nuevo.

La tecnología utiliza geometría simple y la ley de los cosenos para calcular los ángulos creados en el yoga. Por ejemplo, en algunas posturas una pierna doblada debe estar en un ángulo de 90 grados, mientras que el brazo extendido debe formar un ángulo de 160 grados.

Rector optó por utilizar el software de Kinect porque es de código abierto y de fácil acceso en el mercado, pero dijo que tiene algunas limitaciones en el nivel de detalle con el que se detecta el movimiento .

El equipo de científicos piensa hacer que esta tecnología esté disponible online para que los usuarios puedan descargar el programa, conecten su Kinect y empiecen a hacer yoga. El equipo también está llevando a cabo otros proyectos que ayudan con el ejercicio físico.

Referencia bibliográfica:

Kyle Rector, Cynthia L. Bennett, Julie A. Kientz. Eyes - Free Yoga : An Exergame Using Depth Cameras for Blind & Low Vision Exercise. DUB Group | University of Washington (2013).

Kyle Rector, Cynthia L. Bennett, Julie A. Kientz. Eyes - Free Yoga : An Exergame Using Depth Cameras for Blind & Low Vision Exercise. DUB Group | University of Washington (2013).

Tendencias Científicas

Tendencias Científicas

La Inteligencia Artificial puede ver a través del espejo

La Inteligencia Artificial puede ver a través del espejo CIENCIA ON LINE

CIENCIA ON LINE