Un equipo del departamento de Ingeniería Eléctrica e Informática de la Universidad de Delaware (Estados Unidos) ha diseñado un algoritmo capaz de detectar las emociones de las personas en una fotografía grupal. Lo han logrado gracias al uso del aprendizaje automático (machine learning) y el aprendizaje profundo (deep learning) con redes neuronales.

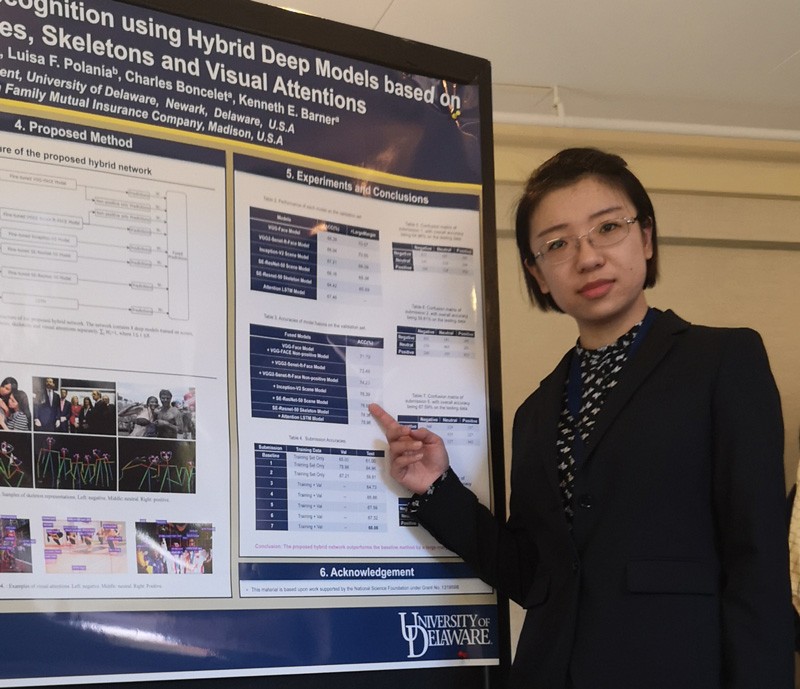

El equipo, liderado por la estudiante de doctorado Xin (Cindy) Guo, obtuvo el primer puesto en una de las tres categorías del sexto desafío “Emotion Recognition in the Wild” (Reconocimiento de emociones en la naturaleza): EmotiW 2018. Concretamente, en el apartado de “Reconocimiento de emociones a nivel grupal”.

Los ganadores fueron anunciados en la vigésima Conferencia Internacional de la Asociación de Maquinaria Computacional (ACM) sobre Interacción Multimodal 2018, que se celebró el pasado mes de octubre.

La prueba

A los equipos se les dio un conjunto de imágenes que representaban a un grupo de personas y se les asignó la tarea de desarrollar un algoritmo que pudiera clasificar a las personas en las fotos como felices, neutrales o negativas. Los equipos tuvieron un mes y medio y siete intentos para crear el algoritmo más preciso posible.

El grupo, guiado por el presidente del departamento y asesor de Guo, Kenneth E. Barner, fusionó ocho modelos diferentes para desarrollar su solución ganadora. El algoritmo funciona en fotografías de varias resoluciones y fue publicada por la Association for Computing Machinery.

Aplicaciones

El objetivo del trabajo es clasificar automáticamente las imágenes subidas a sitios web. “Los usuarios verían las imágenes que están buscando porque el algoritmo se ejecutaría y etiquetaría si las personas están felices o no”, explica Guo en un comunicado. “Podría usarse para analizar las emociones de un grupo de personas fotografiadas en una protesta, una fiesta, una boda o una reunión, por ejemplo. Esta tecnología también podría desarrollarse para determinar qué tipo de evento muestra una imagen dada”.

Referencia

X. Guo, B. Zhu, L. F. Polanía, C. Boncelet, K. E. Barner. Group-Level Emotion Recognition Using Hybrid Deep Models Based on Faces, Scenes, Skeletons and Visual Attentions. ICMI '18 Proceedings of the 20th ACM International Conference on Multimodal Interaction. October 2018. DOI: 10.1145/3242969.3264990.

Tendencias Científicas

Tendencias Científicas

La Inteligencia Artificial puede ver a través del espejo

La Inteligencia Artificial puede ver a través del espejo CIENCIA ON LINE

CIENCIA ON LINE